- SEO

- 更新日:

ECサイトや求人サイトによく見られる「データベース型サイト」は、一般的なWebサイトと仕組みやSEO対策の方法が異なります。

今回は、データベース型サイトとはといったところから、データベース型サイトに向けたSEO対策「データベースSEO」の成功ポイントや対策事例などを紹介します。

- データベース型サイトに必要なSEO対策の流れや基本

- 成功に繋がる20のポイントと実際の改善事例を紹介

- よくある課題や便利なSEOツールの活用方法を解説

データベース型サイトのSEO対策ならお任せください!

「対策の優先順位がわからない…」「競合に勝てる施策が見つからない…」

そんなお悩みに、データベース型サイト特有の課題に精通したSEOコンサルタントが、最短ルートで成果に繋がる施策をご提案いたします。

まずは以下のリンクから無料のSEO診断にお申し込みください!

目次

- 1 データベース型サイトとは

- 2 データベース型サイトのSEOの流れ

- 3 データベース型サイトのSEOを成功させるポイント

- 3.1 ポイント1:クロールしやすい構造にする(クローラビリティ)

- 3.2 ポイント2:インデックスの最適化(インデクサビリティ)

- 3.3 ポイント3:PLP の一致

- 3.4 ポイント4:キーワードとテーマの一致

- 3.5 ポイント5:ページテンプレートの改善

- 3.6 ポイント6:オムニチャネルマーケティングの管理

- 3.7 ポイント7:下落要因の自動アラートを確立

- 3.8 ポイント8:リソース配分の改善

- 3.9 ポイント9:高度なテクニカルSEOの投資に協力的な環境作り

- 3.10 ポイント10:説得力のあるSEOレポート作成

- 3.11 ポイント11:URL正規化

- 3.12 ポイント12:静的URL

- 3.13 ポイント13:整理されたXMLサイトマップ

- 3.14 ポイント14:回遊しやすい内部リンク

- 3.15 ポイント15:低品質なページの削除・noindex

- 3.16 ポイント16:労力のかかったコンテンツ

- 3.17 ポイント17:構造化データ

- 3.18 ポイント18:バックリンク

- 3.19 ポイント19:ユーザー体験を向上するコンテンツ

- 3.20 ポイント20:AIO対策

- 4 データベースSEOに役立つツール

- 5 データベースSEOと一般的なSEOの違い

- 6 データベース型サイトのSEOの事例

- 7 データベース型サイトのSEOのよくある質問

- 8 まとめ

- 9 データベース型サイトのSEOならお任せください!

お急ぎの方は、ご要望別のリンクをご利用ください

・対策のポイントを知りたい!

→ 「データベース型サイトのSEOを成功させるポイント」へ

・データベース型サイトのSEO対策の成功事例を知りたい

→ 「データベース型サイトのSEOの事例」へ

・データベースSEOに役立つツールを知りたい

→ 「データベースSEOに役立つツール」へ

・対象となるサイト・流れから網羅的に知りたい

→ このまま読み進めてください。

データベース型サイトとは

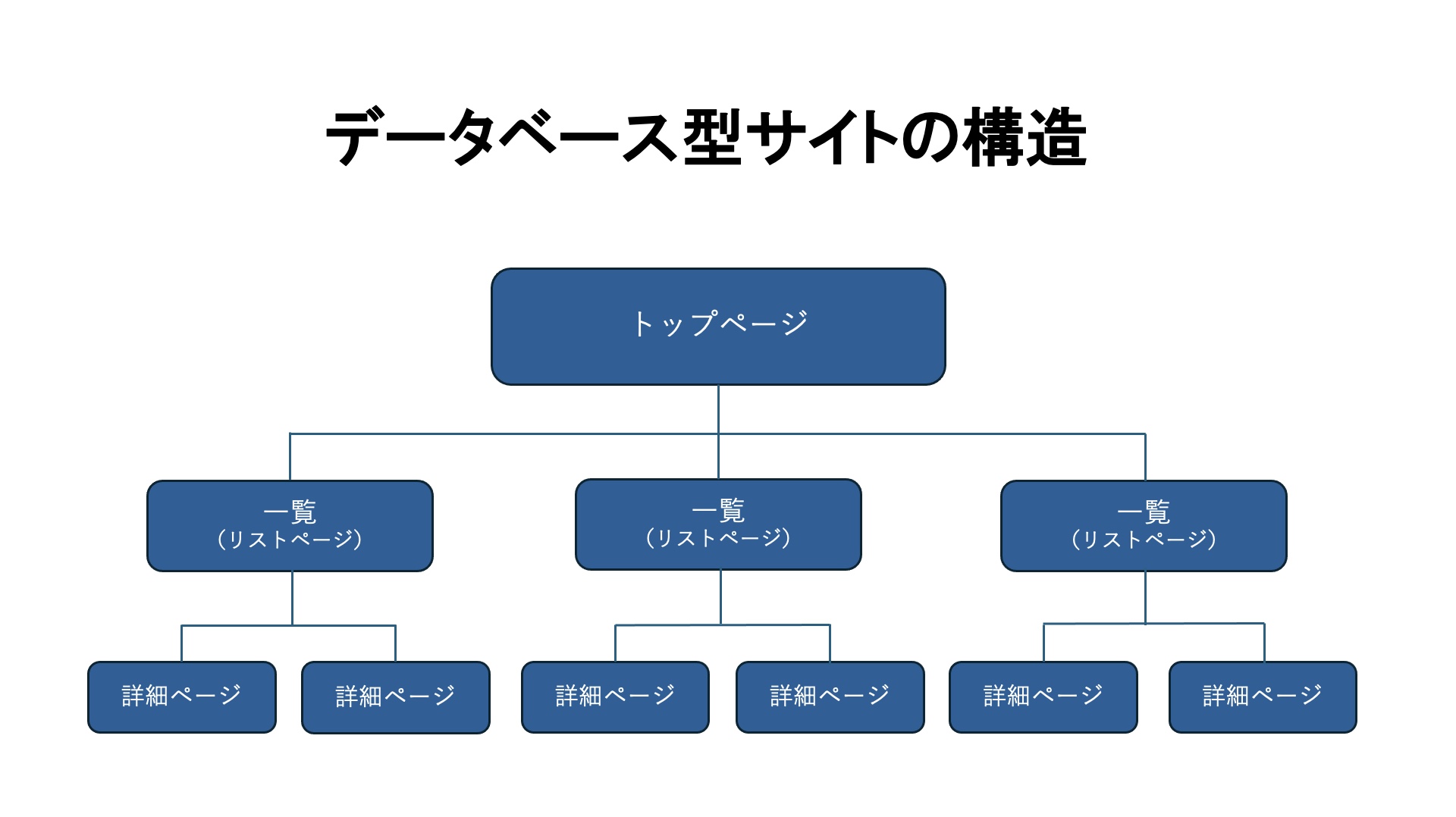

データベース型サイトとは、データベースに保存された情報を必要に応じて取り出して使用するWebサイトのことです。データベース上で商品や店舗情報など特定のデータを追加・更新することで、Webサイトにおいても新規にページが生成されたり、情報が更新されます。

また、Amazonや楽天などのECサイトを思い浮かべるとイメージしやすいですが、データベース型サイトは基本的にカテゴリごとにデータがまとめられる構造のため、条件を絞りながら欲しい情報を探すことができ、ユーザーにとっても使いやすいつくりになっています。

大量の情報を効率よく管理できるしくみ・構造のため、膨大なデータを扱う大規模サイトで主に活用されています。

データベースSEOの対象となる業種

大規模サイトの運営が必要な業種はデータベースSEOの対象となります。一般的に、以下のようなサイトが挙げられます。

- ECサイト(Amazon、楽天市場など)

- 求人サイト(マイナビ転職、リクナビNEXTなど)

- 不動産情報サイト(SUUMO、アパマンショップなど)

- グルメサイト(食べログ、ぐるなびなど)

- レシピサイト(クックパッド、DELISH KITCHENなど)

- 旅行・ホテルサイト(一休.com、じゃらんなど)

- UGCサイト(Youtube、Wikipediaなど)

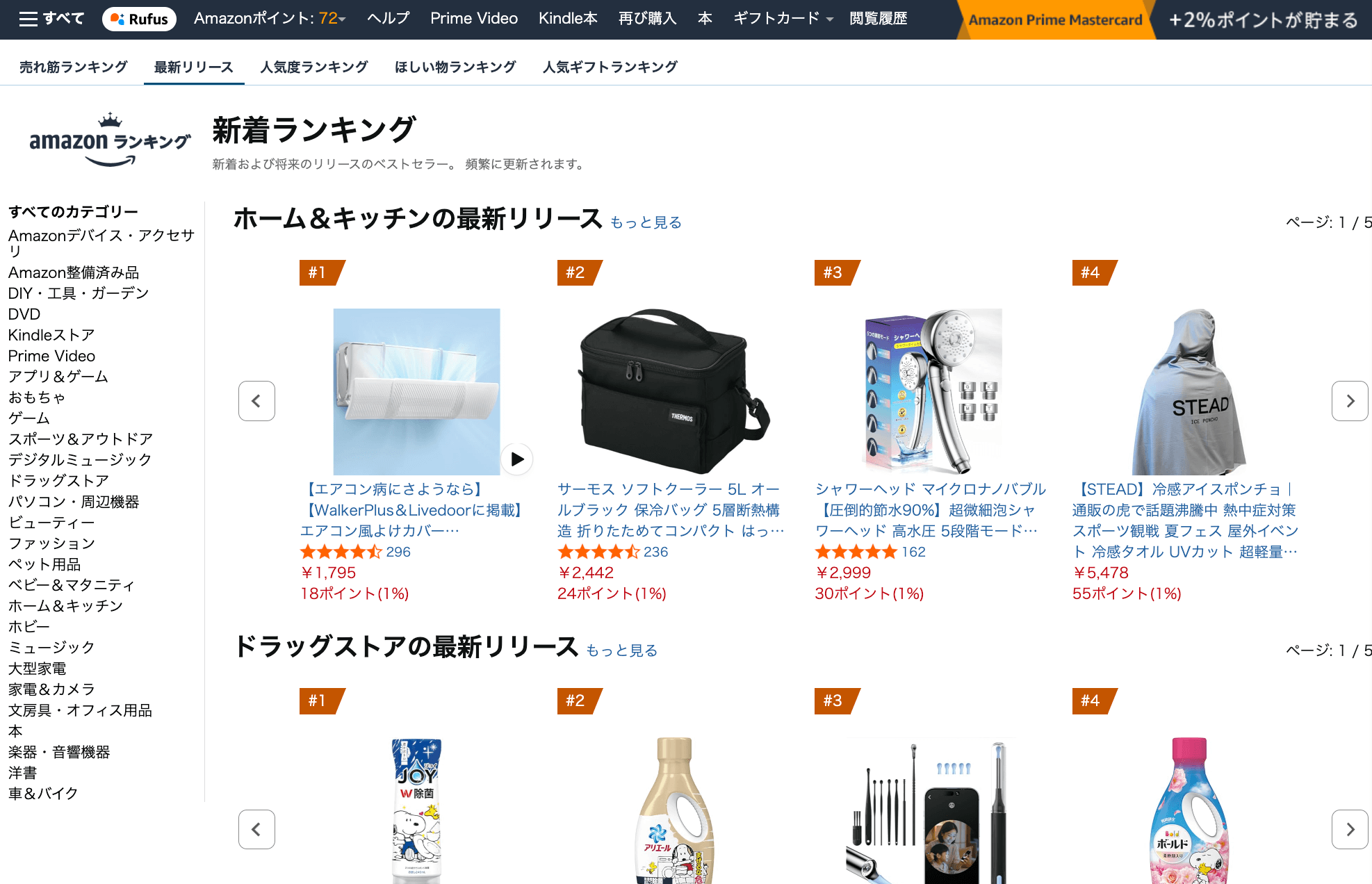

ECサイト

画像引用:Amazon

ECサイト(EC= electronic commerce)とは、製品やサービスを販売するためのWebサイトのことです。代表的な例としては、Amazonや楽天市場、Yahoo!ショッピングなどの「インターネットショッピングサイト」が挙げられます。

ECサイトは電子商取引をおこなうWebサイトを総称するため、ネットショップのほかに「ネットオークションサイト」や「コンテンツ配信サイト」なども含まれます。

販売形式には自社サイト型やモール型などがあり、扱う製品やサービスの数によってサイトの規模は異なりますが、特に商品点数が多くなる場合にはカテゴリ配下に商品ページをもたせることが多いためデータベース型サイトでの運営に適しています。

求人サイト

画像引用:マイナビ転職

求人サイトとは、一般的にさまざまな業界・職種の求人情報を掲載しているWebサイトのことです。代表的な例としては「マイナビ転職、リクナビNEXT、doda」などが挙げられます。

多くの求人情報を保有しているため、ユーザーが職種や希望条件などを絞って探せるようデータベース型サイトで運営する企業が多いです。

不動産情報サイト

画像引用:SUUMO

不動産情報サイトのデータベース型サイトとして代表的なのは、物件情報を掲載しているWebサイトのことです。例としては「SUUMO、アパマンショップ、いい部屋ネット」などが挙げられます。

複数の不動産会社のもつ全国の物件情報を保有しており、情報の更新や入れ替わりも激しいほか、ユーザーが希望条件を絞って情報を探せるようデータベース型サイトが適しています。

グルメサイト

画像引用:ぐるなび

グルメサイトとは、一般的に飲食店の店舗情報やメニューなどを掲載しているWebサイトのことです。代表的な例としては「食べログ、ぐるなび、ホットペッパー」などが挙げられます。

グルメサイトでは、全国の飲食店を取り扱うため膨大な量のデータを保有するほか、飲食店選びの参考にしたいユーザーが条件を絞って探せるよう、多くの企業がデータベース型のサイトを運営しています。

レシピサイト

画像引用:クックパッド

レシピサイトとは、さまざまな料理の調理方法を掲載しているWebサイトです。

代表的な例には「クックパッド、DELISH KITCHEN、キューピー3分クッキング」などが挙げられます。

レシピサイトには、ユーザーがレシピを投稿する「投稿型」とサイトがレシピを提供する「提供型」があり、とくに投稿型を運営する際はページを自動生成できるデータベース型サイトのしくみが適しています。

提供型の場合も、大量のレシピを提供したり、ユーザーが条件を絞ってレシピを検索したりできるようデータベース型サイトを利用するのが一般的です。

旅行・ホテルサイト

画像引用:一休

旅行・ホテルサイトとは、宿泊施設に関する情報を掲載しているWebサイトのことです。代表的な例には「一休.com、じゃらん、agoda」などが挙げられます。

旅行・ホテルサイトは、全国各地にある宿泊施設の情報を保有するほか、ユーザーの希望条件に沿った宿泊プランを提供できるよう、多くの企業がデータベース型サイトでの運営を行っています。

UGCサイト

画像引用:Youtube

UGC(User Generated Contents)サイトとは、一般ユーザーによって生成されたコンテンツが掲載されているWebサイトのことです。ブログやSNS、商品や店舗へのレビューや口コミサイト、電子掲示板などが該当します。代表的な例として「Youtube、Wikipedia、Instagram」などが挙げられます。

ユーザーの投稿に応じてページが更新される仕組みで、非常に高い頻度で更新が行われるため、データベース型サイトでの運用が適しています。

データベース型サイトのSEOの流れ

データベース型サイト向けのSEO施策は、一般的に下記の流れでおこないます。

- インデックスエラー

- クロールのアクセスログ

- キーワード分析

- 競合調査

- 施策の優先度

- コンテンツの最適化

- URL構造の最適化

- 内部リンクの構築

- バックリンクの獲得

- XMLサイトマップの送信

- パフォーマンスの監視

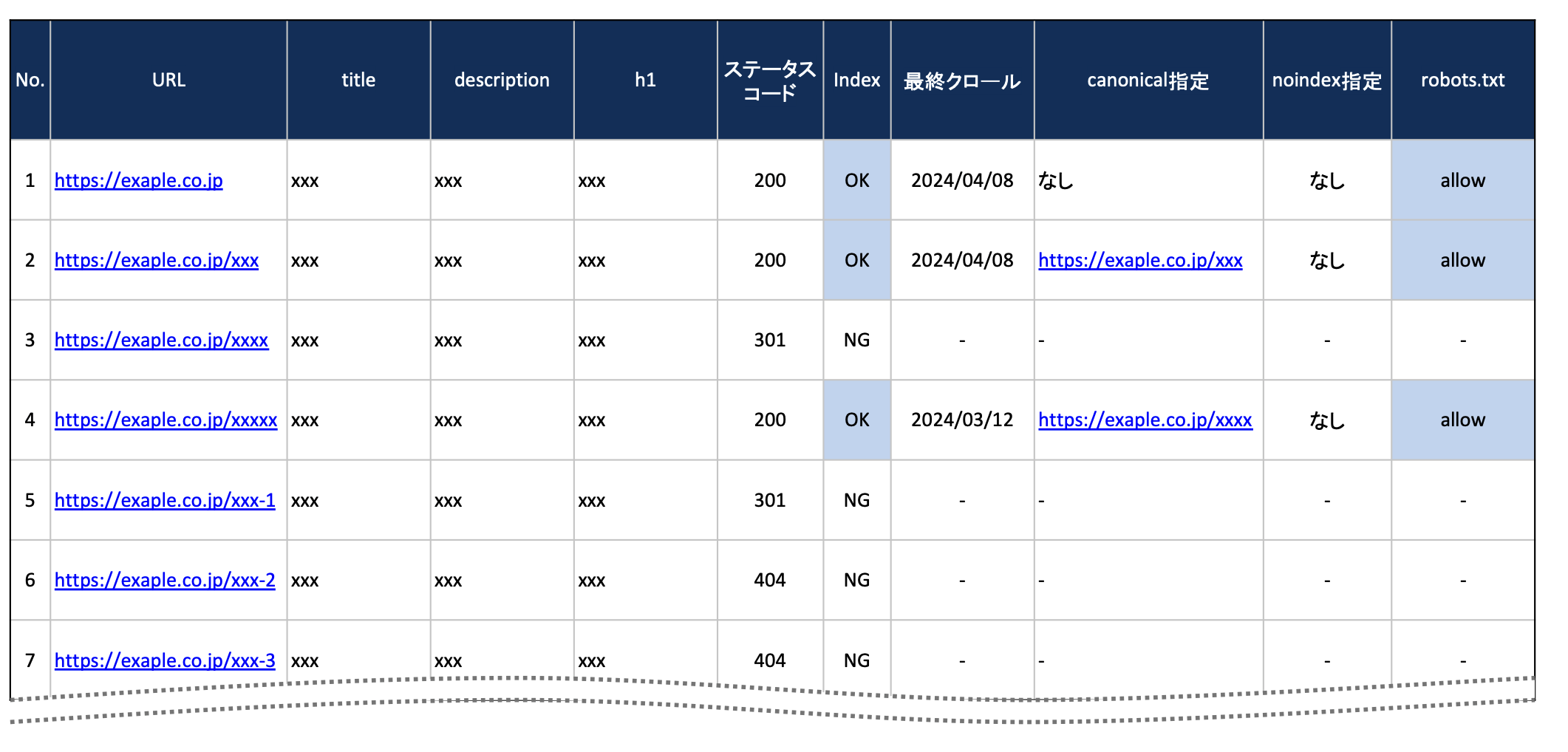

流れ1:インデックスエラー

データベース型サイトのSEOでは、まずGoogle Search Consoleでページのインデックス状況を確認し、インデックスエラーを分析することが不可欠です。

データベースサイトのSEOにおいて、最初に着手する内容は企業やコンサルタントごとに異なりますが、弊社ではキーワード調査よりもインデックスエラー調査を優先し、サイトのボトルネック部分を特定することを推奨しています。

canonicalタグの記述や重複・ソフト404、インデックス未登録の原因分析を行い、エラーの傾向を掴んだ上で、共通する課題ごとに的確な対応策を講じましょう。

流れ2:クロールのアクセスログ

インデックスエラーの分析と並行して、GooglebotやAIbotがサイトをいつ、どのような頻度でクロールしているか、アクセスログを確認することも重要です。

クロール頻度が低い、あるいは内部リンクが未設置で孤立ページ化している場合など、インデックスエラーの要因がログから見えてきます。こうしたログをもとに、クロール状況の問題点を仮説立てし、具体的な改善策を検討しましょう。生ログ解析はクロール管理やSEO施策の精度向上に不可欠です。

流れ3:キーワード分析

まずはキーワード分析をおこない、多くのユーザーが検索しているキーワードを把握します。SEOではユーザビリティに配慮したサイトづくりが評価される傾向にあるため、検索ボリュームの高いキーワードでコンテンツをつくり、上位表示を狙うことが大切です。

流れ4:コンテンツの最適化

つぎに、重複コンテンツの削除やcanonical属性の設定などをおこない、コンテンツの最適化を図ります。

「流れ3」で選定したキーワードに応じてコンテンツのタイトルやディスクリプション、本文の最適化もおこないましょう。

また、クローラーがコンテンツ内の情報を正しく理解できるよう構造化データのマークアップ作業も欠かせません。

流れ4:競合調査

キーワード分析で自社の流入キーワードを把握した後は、競合サイトの流入キーワードや同一キーワードでの順位比較も行いましょう。

加えて、被リンク数や総ページ数、(求人系サイトなら)非公開・公開求人数なども数値化し、各サイトの「戦闘力」を見比べます。

こうした横断的なデータで大きな差が判明すれば、インデックス最適化や内部施策だけでは順位逆転が困難な場合もあるため、戦略自体を見直す必要性もあります。

流れ5:施策の優先度

分析を終えて各課題への仮説と施策案を洗い出したら、順位向上への効果やKPI、対応キーワードへの影響度を基準に施策の優先度を決定します。

優先付けにはSEOの経験値と、限られたリソースで最短距離でKPI達成を目指す戦略的思考が必要です。もし苦手な場合は経験者や上長の意見も積極的に取り入れましょう。

優先順位設定を誤ると工数や予算を無駄にし、大きくKPI未達となるため、最重要と言えるプロセスです。

流れ6:URL構造の最適化

限定的ですが、URLの構造もSEOに関わりがあると考えられているため、短くてわかりやすいURLに最適化することがおすすめです。

下記記載のGoogleの推奨するURL構造を把握して最適化を図りましょう。

- シンプルでわかりやすい単語を使用する。意味のない長いID番号や、絵文字、記号などは使用しない。

- 該当する場合にローカライズした単語をURLに使用する。

- 必要に応じてUTF-8エンコードを使用する。

- ドメイン、サブディレクトリは国別に使用する。

- 2語以上の単語を使用する場合はハイフンで区切る。アンダースコアは使用しない。

流れ7:内部リンクの構築

Webサイト内のページをつなぐ内部リンクを構築しましょう。

関連性の高いページ同士に内部リンクを設置することで、クローラーがサイト内を巡回しやすくなったり、ユーザーのサイト滞在時間を伸ばせたりします。

内部リンクの構築では、正しいURLの設置やリンク先の内容がわかりやすいアンカーテキストの作成などが重要です。

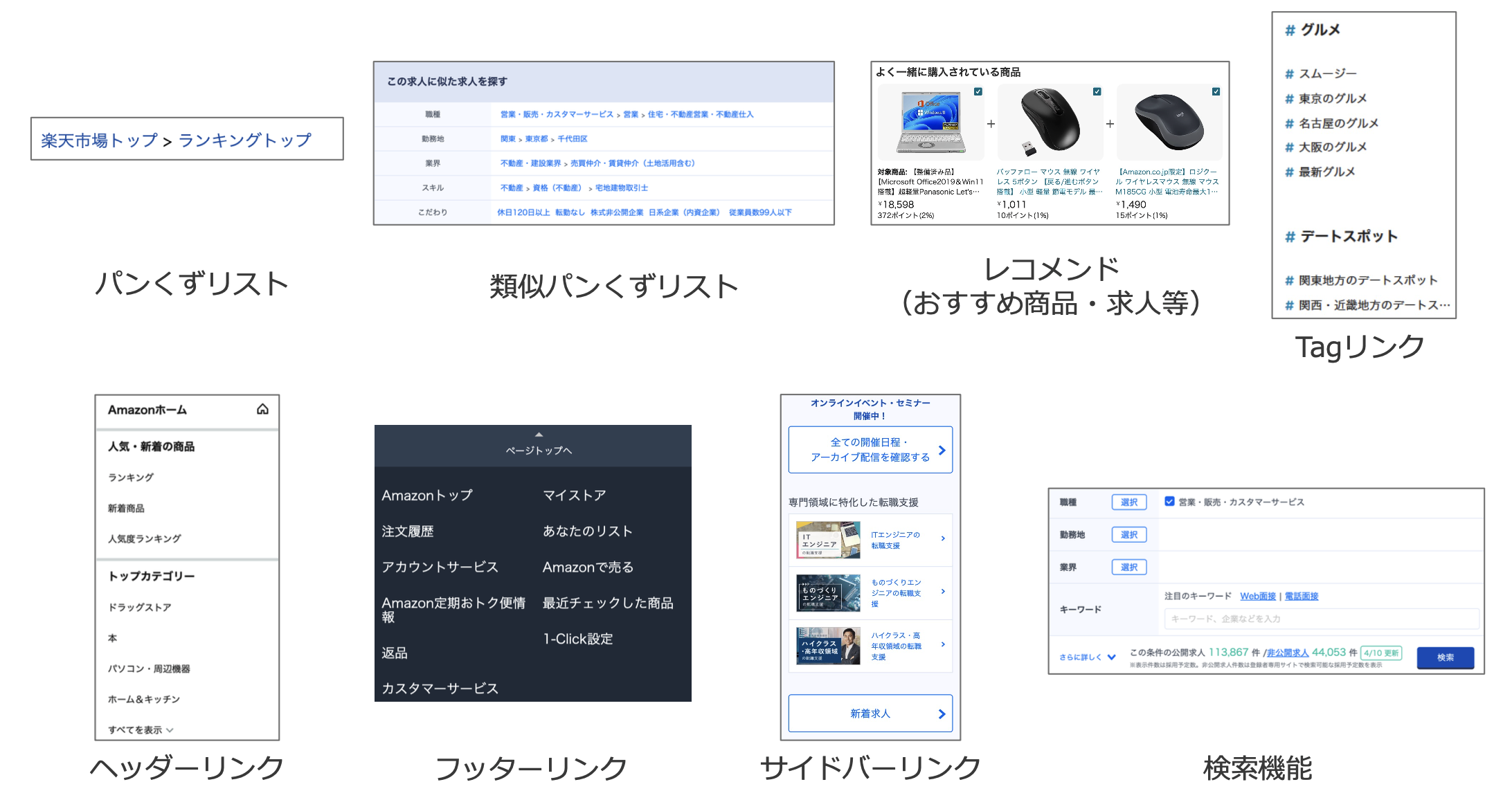

特にデータベース型サイトにおいては、ユーザーの行動履歴からおすすめのページを表示したり、現在のページのコンテンツと共通する特徴を持つページへのリンクを設置すると良いでしょう。

下記記事では、SEOにおいて効果的な内部リンクの貼り方、設置場所などについて開設しているので、ぜひ併せてご覧ください。

内部リンクとは?SEO効果が期待できる貼り方・チェック項目

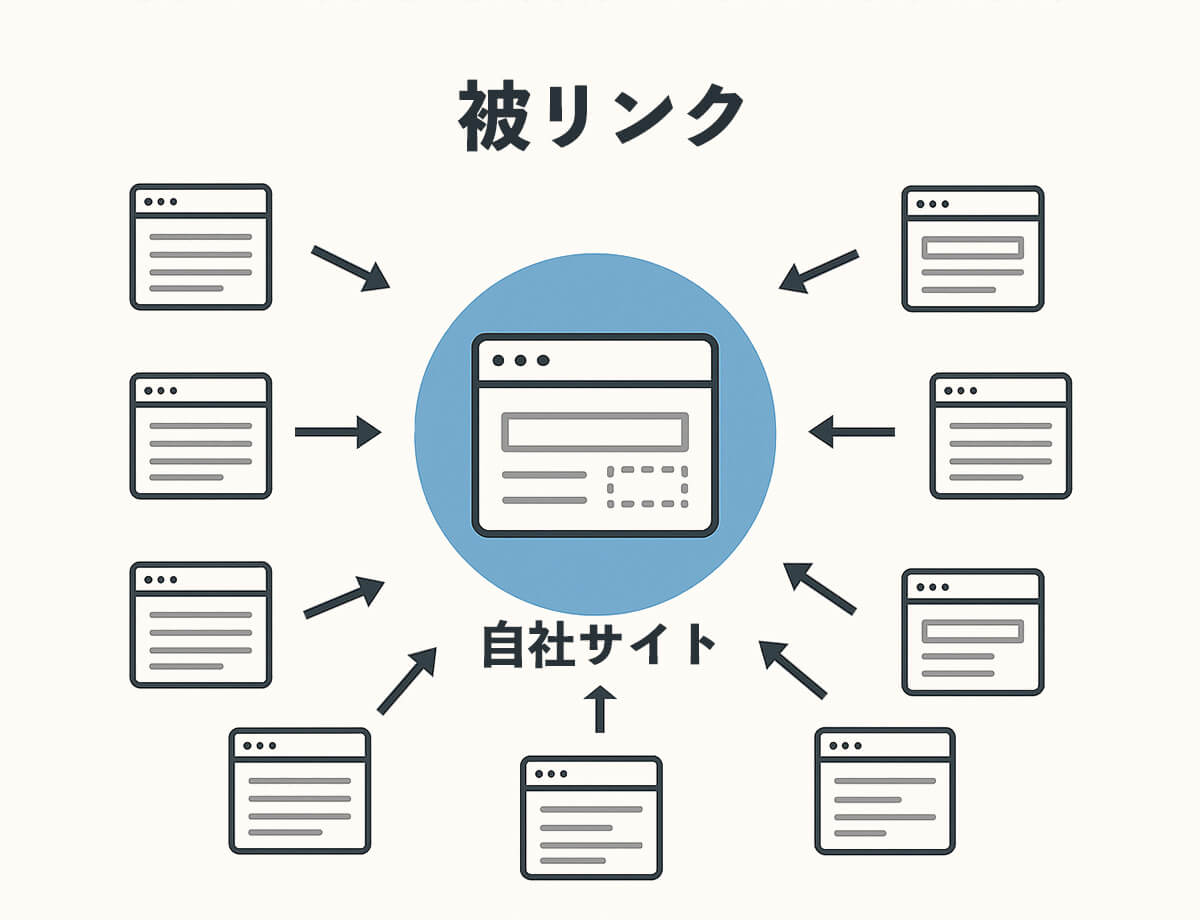

流れ8:バックリンクの獲得

バックリンクとは、別名被リンクとも呼ばれ、他のWebサイトに自社サイトのリンクが設置されることです。バックリンクを獲得すると、自社サイトの評価やユーザーの訪問数のアップが期待できます。

ただし、質の低いバックリンクの場合、プラスの効果はありません。ドメインパワーの強いサイトからのリンクやページの内容に関連性のあるサイトからのナチュラルリンクのように、質の高いバックリンク獲得を目指しましょう。

以下では、「被リンクの質を左右するページランク」や「ナチュラルリンクの特徴や獲得方法」などについてそれぞれ解説しているので、ぜひ参考にしてください。

ページランクとは?SEOにもたらす効果を解説!

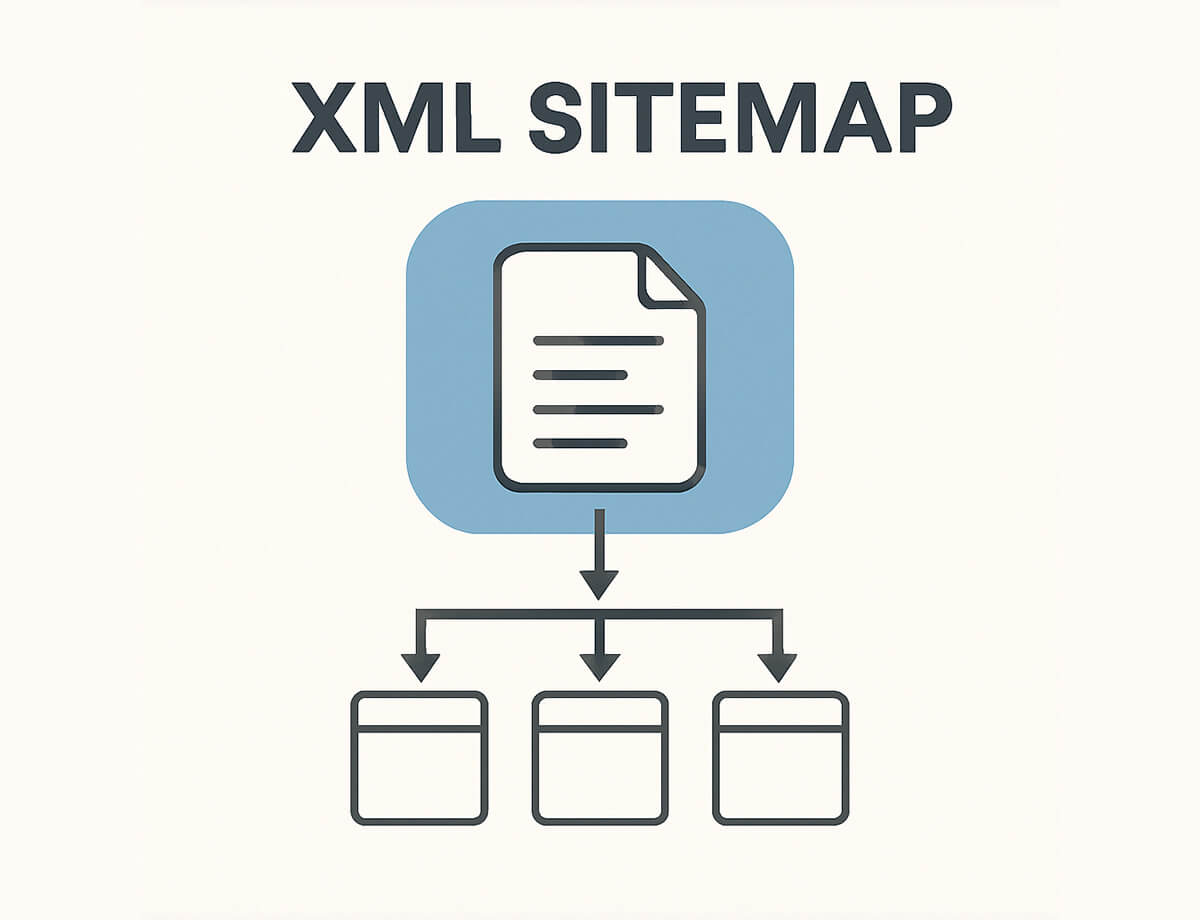

流れ9: XMLサイトマップの送信

既存コンテンツを修正した際や新規ページが作成された際は、都度XMLサイトマップを送信しましょう。XMLサイトマップは検索エンジンのクロールを促進させる効果があるため、サイトの更新内容をできるだけ早くインデックスに反映させ、検索結果に表示させることができます。

流れ10:パフォーマンスの監視

SEO施策による効果を測定するために、施策後はパフォーマンスの監視をおこないましょう。キーワードランクの追跡や読み込み速度の測定、バックリンクの追跡などの機能が搭載されたツールを用いて、Webサイトのパフォーマンスを確認しましょう。

Google Analytics(GA4)やSeach Console、PageSpeed Insightsなど、Googleが無償で提供しているツールだけでも、使いこなすことが出来れば十分なパフォーマンス計測が可能です。

ただし、アクセス数やページ数が膨大になる場合は、無償ツールだけでは不足が出る場合もあるので、分析したい項目に合わせてツールを検討すると良いでしょう。

データベース型サイトのSEOを成功させるポイント

データベース型サイトのSEOを成功させるうえで重要な20のポイントを紹介します。

- クロールしやすい構造にする(クローラビリティ)

- インデックスの最適化(インデクサビリティ)

- PLP の一致

- キーワードとテーマの一致

- ページテンプレートの改善

- オムニチャネルマーケティングの管理

- 下落要因の自動アラートを確立

- リソース配分の改善

- 高度なテクニカルSEOの投資に協力的な環境作り

- 説得力のあるSEOレポートを作成

- URL正規化

- 静的URL

- 整理されたXMLサイトマップ

- 回遊しやすい内部リンク

- 低品質なページの削除・noindex

- 労力のかかったコンテンツ

- 構造化データ

- バックリンク

- ユーザー体験を向上するコンテンツ

- AIO対策

ポイント1:クロールしやすい構造にする(クローラビリティ)

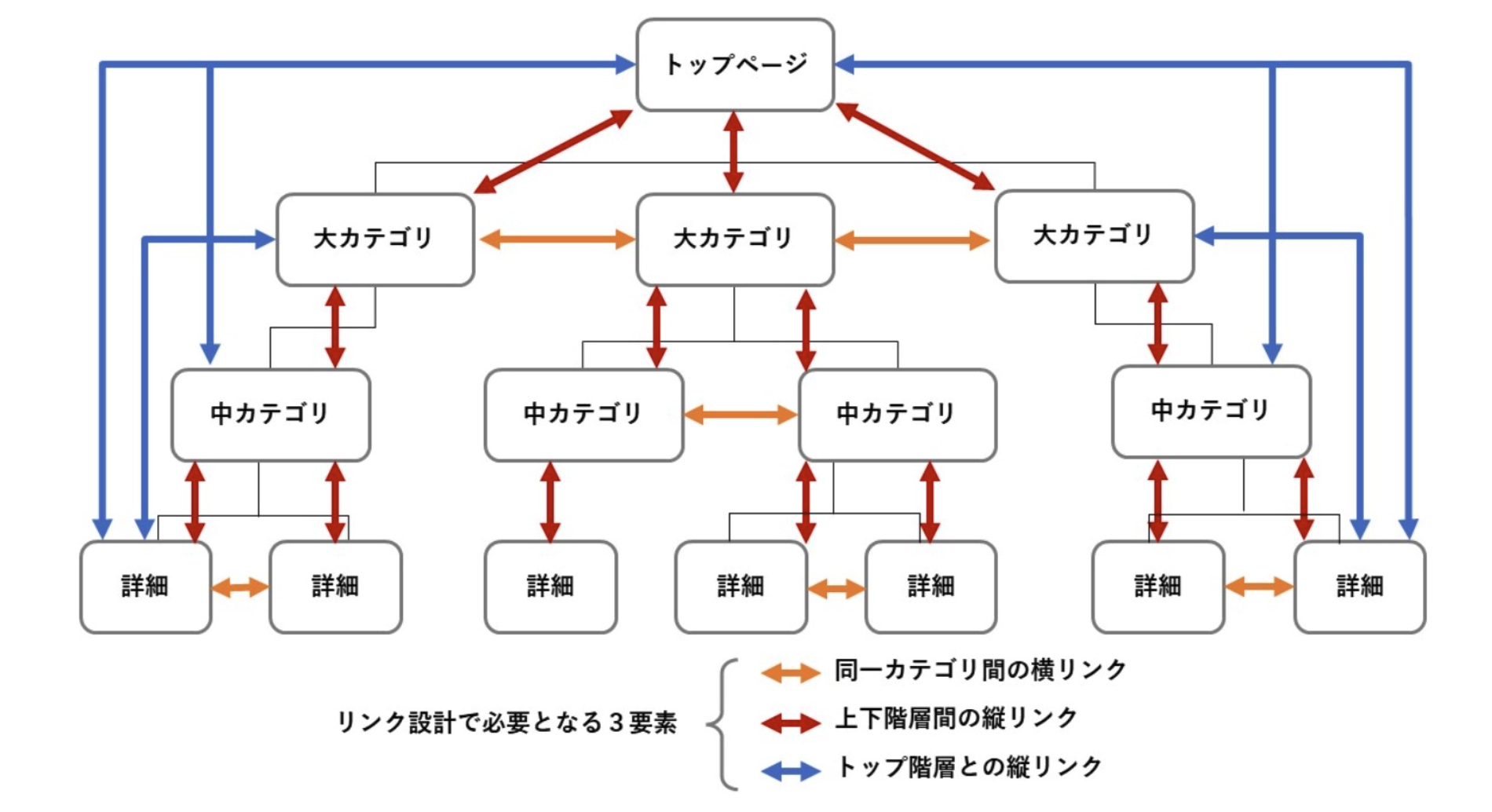

SEOでは、クローラーがWebサイトをクロールしやすいようクローラビリティを向上させることが重要です。

クローラーは、検索エンジン上にある膨大なWebサイト・ページの情報を巡回し、評価やインデックスをおこないます。

しかし、Googleがクロールしてくれるページ数には限りがあるため、膨大なページが生成されるデータベース型サイトでは以下に効率よくクロールしてもらうかが重要となります。

以下のように、各階層間、各カテゴリ間、詳細ページ間同士でリンクをつなぎ、どこからもリンクがない離れ小島のようなページがないようにしましょう。

クローラーはページ内のリンクをたどるため、以下のように内部リンクを充実させることも重要です。

その他、クローラビリティの向上を図る施策には、下記のようなものがあります。

- Googleサーチコンソールからインデックス登録をリクエストする

- XMLサイトマップを送信する

- URL構造を見直す

- 内部リンクを最適化する

- パンくずリストを設定する

- noindexタグを設定する

- バックリンクの獲得 など

また、1サイトにおけるクロール可能なページ数にはクロールバジェットという上限が設けられています。

Webサイトの増大に伴い、クロールリソースを確保するために、クロールバジェットは削減傾向にあるため、より重要なページをクロールしてもらえるような施策も重要です。

ポイント2:インデックスの最適化(インデクサビリティ)

自社のWebサイト・ページを検索結果に上位表示させるには、コンテンツの最適化ももちろん大切ですが、最適化した内容をクローラーに正しくインデックスしてもらうことが非常に重要です。このようにインデックスを最適化することを「インデクサビリティ」と呼びます。

インデクサビリティを確保するには、以下のような項目の最適化が必要です。

- コンテンツの独自性

- ページの相対的な重要性

- E-E-A-T

- 重複・類似コンテンツ

- UI / コアウェブバイタル

- 更新性

- ユーザー行動シグナル

- バックリンク

特に重要なのは独自性のあるコンテンツです。他のサイトと比較して相対的に重要と判断される必要があります。

ポイント3:PLP の一致

PLP(Preferred Landing Page)とは「対策キーワードごとに定めた上位表示させたいページ」のことです。PLPの一致は、ユーザーの検索意図に沿ったコンテンツ作成ができていることを示すため、上位表示されやすくなったりCV数向上につながったりします。

データベース型サイトは保有・提供しているデータが多く、Webサイト内でカニバリが発生したりPLPがインデックスされなかったりなど、PLPの不一致を招きやすいので注意が必要です。

ポイント4:キーワードとテーマの一致

SEO施策の効果を高めるためには、選定キーワードとコンテンツのテーマを一致させることが大切です。

クローラーは、ユーザーの検索クエリの意図を理解した後、関連性の高いコンテンツの順に検索結果ページに表示させます。そのため、検索意図を理解したキーワード選定はもちろん、選定したキーワードで上位表示されるためには、キーワードとコンテンツのテーマの関連性を高める必要があります。

ユーザー意図を理解したキーワードへの最適化、選定キーワードに一致したテーマ設定をおこないましょう。

ポイント5:ページテンプレートの改善

データベース型サイトは、基本的にページテンプレートを活用してコンテンツを量産します。

テンプレートの設定が最適化されていない場合、そのテンプレートを活用しているすべてのページの評価に影響を与えてしまうため、データベース型サイトのSEOではテンプレートを改善することが重要です。

また、保有するページ数が多いことから、コンテンツをひとつひとつ改善すると工数がかかってしまうほか修正ミスがページごとに発生してしまう可能性があります。テンプレート単位でSEO施策を施すことで、作業の効率や正確性を高めることも期待できるのです。

ページテンプレートごとに、メタタグの最適化やメインコンテンツ・サブコンテンツの内容とテーマの関連性強化などの改善をおこないしましょう。

ポイント6:オムニチャネルマーケティングの管理

Webサイトに訪問したユーザーだけでなく、実店舗、アプリなどさまざまな販売経路の顧客を一括管理できる「オムニチャネルマーケティング」の導入・最適化も重要です。

オムニチャネルマーケティングによって顧客との接点を増やすことで、各顧客に適切なアプローチをできるようになりCV数の向上が期待できます。

また、チャネルごとの在庫を一括に管理することで在庫管理の質が高まり、販売機会の損失を防ぐ効果もあります。

ポイント7:下落要因の自動アラートを確立

大規模なデータベース型サイトの場合、全てのSEO項目を人力で監視することは困難です。

SEOツールやサイト解析ツールなどを活用することで、SEO項目を自動でチェックしエラーがあればアラートがかかるようにすることで、SEOの機会損失を最小限に防ぐことができます。

以下の画像は参考例になります。

具体的なツールについては、後述していますので参考にしてください。

ポイント8:リソース配分の改善

サイトのパフォーマンスを最適化するためにも、リソース配分の改善は重要な施策です。

データベース型サイトは、データベースの情報をもとにコンテンツが自動生成されるためデータ量の増加やデータベース内のインデックスの設定不足により、ページの表示速度や動作が遅くなる可能性があります。

このようなパフォーマンスの低下は、ユーザーの早期離脱やクローラーの評価低下を招く恐れがあるため、CPUやメモリ、ディスクなどサーバーのリソースを適切に割り当て、データベースの最適化やキャッシング技術を利用することが重要です。

ポイント9:高度なテクニカルSEOの投資に協力的な環境作り

テクニカルSEOとは、クローラビリティやインデクサビリティの向上を図るといったように内部構造を最適化する施策のことです。データベース型サイトのSEOでは高度なテクニカルSEOを要するため、専門的な知識や技術を持った人材や専用ツールを活用といった投資が必要になります。

データベース型サイトのSEO施策においてテクニカルSEOへの投資は欠かせないため、人件費やコンサル代、ツール導入・運用などは必要経費であると社内での理解を得られるように働きかけ、環境を整えるようにしましょう。

ポイント10:説得力のあるSEOレポート作成

SEOレポートとは、SEO対策の成果や事業貢献度、検索エンジンのパフォーマンスなどをまとめ、上司やクライアントに報告するための資料です。

これまでに実施したSEO対策の実施結果を提示し、今後の施策の方向性を決める役割を果たします。説得力のあるSEOレポートを作成することで「ポイント9:高度なテクニカルSEOの投資に協力的な環境作り」に役立ちます。

「キーワード順位表、カテゴリごとの流入数測定表【週次・月次】、ページ別パフォーマンス表、抽出データ貼り付け表」といった必要な事項を記載し、SEO対策の実施結果を明確に示しましょう。

ポイント11:URL正規化

データベースSEOにおいてURL正規化は重要な基本施策です。

パラメーター付きや類似条件ページなど動的に生成される重複・類似URLについては、canonicalタグで評価を一つの正規ページへ集約し、検索エンジンのクロール効率・順位集中を図ります。

また多言語サイトではhreflangも正しく実装し、適切な評価とインデックス誘導を実現してください。

ポイント12:静的URL

動的URLでもGoogleは認識可能としていますが、現実的にはインデックス効率やクリック率、ユーザビリティの観点から静的URLの方が有効です。

特に重要なページや狙いたいキーワードには、パラメーターを排除した静的URLを用意することで、トラフィックや評価の分散を防ぎ、ページ単位でのSEO効果を最大化できます

ポイント13:整理されたXMLサイトマップ

データベースSEOでは、膨大なURLを管理するため、XMLサイトマップの整理が不可欠です。

1ファイルあたり最大5万URL・50MBまでという制限があるため、複数ファイルに分割し、sitemapインデックスで構造的に整理することが重要です。

サイト構造や優先順位を反映し、効率的なクロール誘導とインデックス精度向上に役立つ設計を徹底しましょう。

ポイント14:回遊しやすい内部リンク

クロールとインデックスの傾向的には、XMLサイトマップよりも「回遊しやすい内部リンク」の設計が重要です。

単なるリンク設置ではなく、ユーザーが実際にクリックする動線や文脈、ページ同士の関連性を考慮し、自然に回遊したくなる位置にリンクを配置することが肝です。

これによりクローラビリティとインデクサビリティが同時に向上し、SEO効果の最大化につながります。

ポイント15:低品質なページの削除・noindex

データベースSEOでは、低品質ページの削除・noindexは慎重に検討すべき重要施策です。

サイト規模が大きいほど低品質ゼロは現実的でないため、良質ページ比率の向上を重視し、クロール・インデックス状況は都度理由を分析して最適な判断を行いましょう

ポイント16:労力のかかったコンテンツ

Googleは近年、コンテンツ評価の指標として「労力のかかった」(Effort)ことを重視しています。(https://static.googleusercontent.com/media/guidelines.raterhub.com/en//searchqualityevaluatorguidelines.pdf)

データベースSEOでも、

ポイント17:構造化データ

データベースSEOでは、求人やECなどサイトタイプごとに最適な構造化データを正確にマークアップすることで、検索エンジンの理解度を高めることが不可欠です。

パンくずリストやFAQ、authorなども例えランキングにクリティカルに直結しなくても、Googleの認識精度向上につながる要素は積極的に実装すべきです。

ポイント18:バックリンク

データベースSEOにおいてもバックリンクは依然として重要な評価指標です。

他サイトからのリンク流入によってクロールやインデックス促進が期待でき、検索順位やドメインパワー向上に直結します。

単にリンク数を増やすだけでなく、ユーザーが実際に遷移し滞在する“質の高い被リンク”を獲得することがSEOの本質です。古典的な施策のためなんとなく牽制されがちですが、Googleの基本原則にも沿う施策なので確実に取り組みたいです。

ポイント19:ユーザー体験を向上するコンテンツ

データベースSEOでは、サイト全体の信頼性やブランド価値向上の観点から、直接集客や上位表示を狙わない「ユーザー体験を向上するコンテンツ」(事例・お客様の声・診断ツール・開発秘話・動画など)の充実が差別化のカギとなります。

特に事例や動画、独自の診断ツールなどはユーザーの満足度やエンゲージメントを高め、サイト全体の評価向上に寄与します。今後はこうした体験型・価値訴求型コンテンツを積極的に設計することが競争優位に直結します。

ポイント20:AIO対策

データベースSEOにおけるAIO(AI検索最適化)対策は、AIが情報源として自社ページを引用しやすくするための包括的な情報設計が重要です。

FAQやQ&A形式、Schema.orgによる構造化データの実装、専門性と信頼性を担保した独自情報の充実が基本施策です。

特に「クエリファンアウト」などAI特有のアルゴリズムに対応し、よくある質問を網羅するなど、情報の網羅性と正確性を強化することが、将来的な流入増加とAI時代の競争力確保につながります。

データベースSEOに役立つツール

SEOの効果測定やパフォーマンスの監視をおこなう際には、専用ツールを活用します。この章では、データベースSEOに役立つツールを5つ紹介します。

Ahrefs

「Ahrefs(エイチレフス)」とは、シンガポールが本拠地の「Ahrefs Pte.Ltd社」によって開発され、現在は世界で約60万人に導入されているSEO分析ツールです。

世界最大級の被リンクデータ量を保有しており、自社や競合などあらゆるWebサイトのバックリンク分析に長けています。バックリンクの数やドメインの種類だけでなく、リンク先の権威性や専門性なども調査可能です。

また、バックリンクの計測のほかにも、上位表示記事や流入キーワードの分析結果、ソーシャルメディアの反応などもデータにまとめて把握することができます。

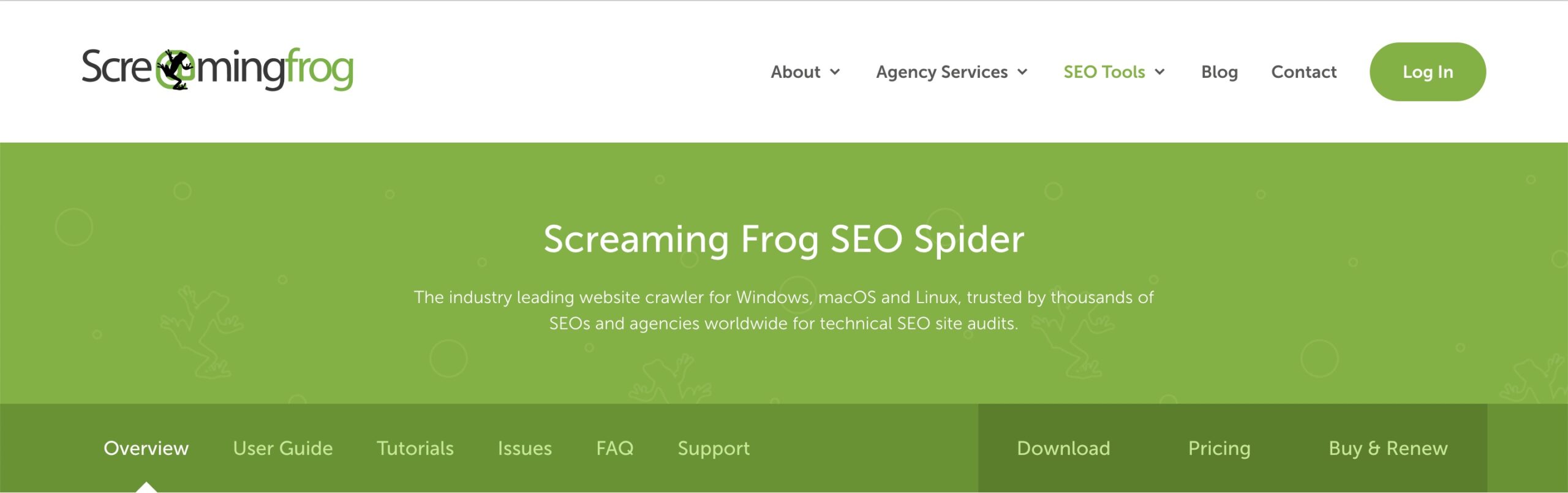

ScremingFrogSpider

「ScremingFrogSpider(スクリーミング フロッグ スパイダー)」は、イギリスのデジタルマーケティング会社「Screaming Frog」によって開発されたSEOツールです。

指定したWebサイトをクロールし、URLやページタイトル、メタ情報、h1タグといったSEOに関わるデータを取得・リスト化します。ほかにも、エラーページやcanonicalタグの問題を確認したり、XMLサイトマップを作成したりすることも可能です。

無料版と有料版があり、データベース型サイトのSEOに活用する場合は有料版がおすすめです。無料版でも十分にSEO分析できますが、一度にクロールできるURL数に制限があったり、GoogleサーチコンソールやGoogleAnalyticsといったツールとの連携ができなかったりするため、大規模サイトのSEOには適していません。

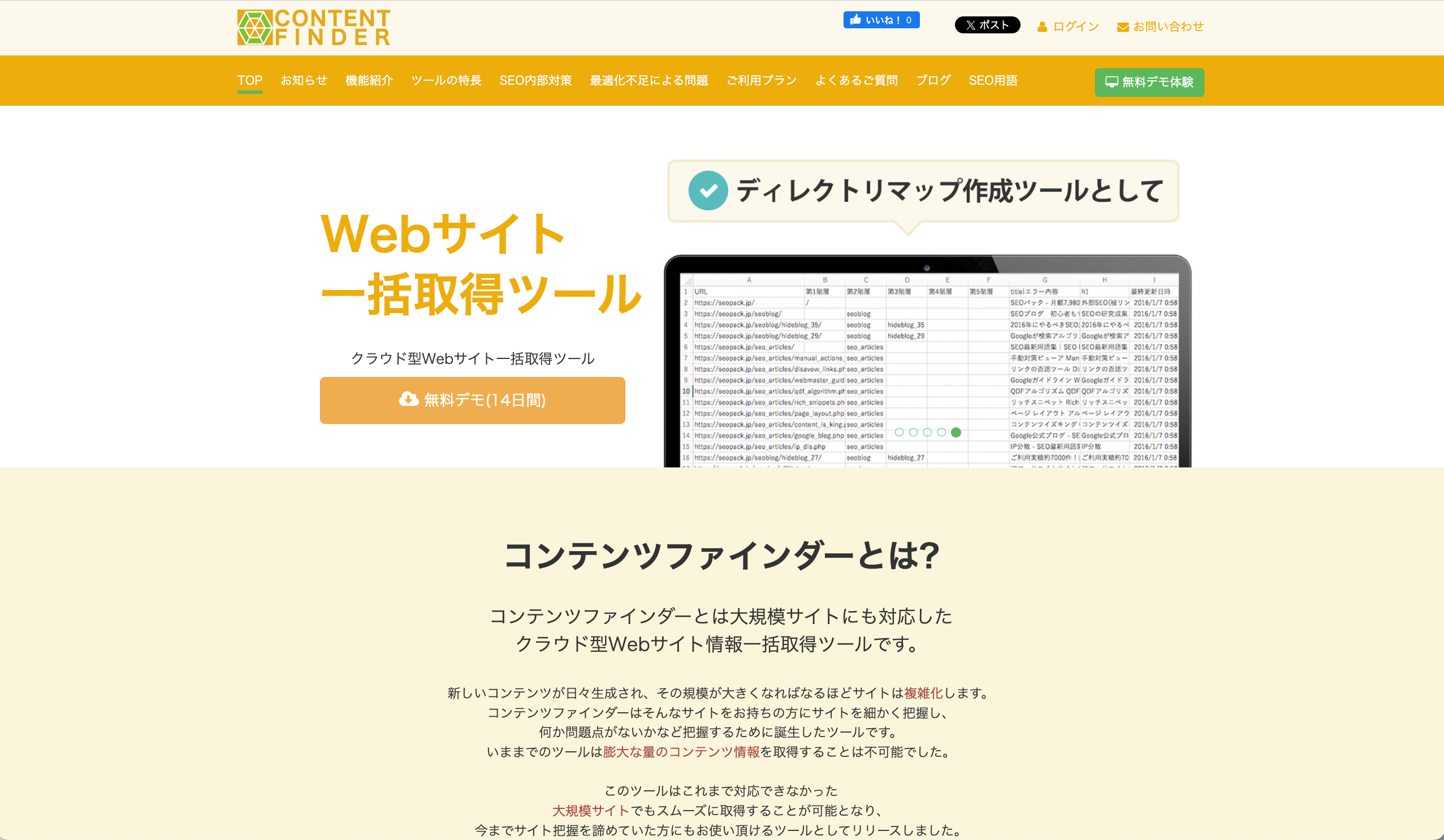

コンテンツファインダー

「コンテンツファインダー」は、「株式会社ディーボ」が開発・提供している大規模サイトにも対応したSEO内部対策ツールです。

ScreamingFrogに近い機能を持ちますが、より分かりやすいUIが特徴です。

リンク切れやリダイレクト、内部・外部リンク、canonical設定などのリンクチェックや、title・description・meta keyword・h1の重複や空白といった重複コンテンツ検出、ディレクトリマップ自動作成が可能です。チェック結果は一覧表示やCSV出力でき、効率的なWeb戦略立案・サイト改善に役立ちます。

SimilarWeb

「SimilarWeb(シミラーウェブ)」とは、イスラエルが本拠地の「SimilarWeb」によって開発されたマーケティングツールです。

自社や競合などあらゆるWebサイトのアクセス分析ができます。

具体的には、サイトに訪問したユーザーの人数や属性、滞在時間、流入経路などの情報をデータ化したり、上位表示サイトの理由やキーワードなどを分析したりすることができます。

無料版と有料版があり、同時にログインできるユーザー数や取得できるデータ数が大きく異なるため、複数の人数で情報共有する場合や、より精密なデータを取得したい場合は有料版の利用がおすすめです。

DS.INSIGHT

「DS.INSIGHT(ディーエスインサイト)」とは、ヤフー・データソリューションによって開発されたデスクリサーチツールです。

LINEヤフーの保有する検索データや位置情報といった「消費者ビッグデータ」を分析することで、消費者の興味関心やニーズ、動向を可視化します。

ユーザーの基本情報や行動心理をデータから把握・推測できるので、顕在・潜在層の把握や詳細なペルソナの作成、市場のトレンドの把握などが可能です。

ターゲットの動向や興味関心を理解することで、適切に効率よくアプローチできる施策考案に役立てることができます。

Dockpit

「Dockpit(ドックピット)」とは、株式会社ヴァリューズによって開発されたリサーチエンジンサービスです。

国内最大規模のWeb行動ログデータをもとに、競合3C(自社・競合・市場)分析が可能です。分析したいWebサイトのURLやキーワード、業界などを絞って調査をかけることができ、アクセス情報や流入キーワード、人気コンテンツなどを分析することができます。

分析結果は数字やグラフを用いてデータ化され、ExcelやPowerPointなどに出力してもらえるため、競合やマーケット全体の動向を視覚的に把握することが可能です。競合・市場分析のほかにも、ユーザー理解、自社のコンバージョン向上の施策考案などに役立てることができます。

Demand Metrics

Demand Metricsは、米国のDemandSphere(旧GinzaMetrics)が開発し、日本ではDemandMarkets株式会社が販売する大規模サイト向けに開発されたクラウド型SEOモニタリングツールです。

検索順位の監視だけでなく、独自技術で検索結果画面(SERP)全体を解析できる点が特長です。

大量のキーワードや競合の順位を日次で自動計測し、ピクセル単位での見え方確認や、被リンク分析、ページごとのSEO診断・コンテンツ分析も可能です。

Amethyst

Amethystは株式会社JADEが提供するSEO分析・モニタリングツールで、主に大規模サイトや複雑なデータベース型サイト向けに設計されています。

主要機能は「Index Worker」(クロール・インデックス状況の分析)と「Search Analytics」(キーワードやページごとに検索パフォーマンスを可視化)です。

Google Search ConsoleやGA4と連携し、流入クエリの分析やインデックス率監視、SEO課題の早期発見が可能です。

データベースSEOと一般的なSEOの違い

データベースSEOと一般的なSEOには、施策の目的と範囲に違いがあります。

一般的なSEOとはページコンテンツの品質向上を目的とし、個別のページにフォーカスして改善施策をおこなうことが多いです。

一方で、データベースSEOは、動的に生成されるページの上位表示を目的としています。そのため、個別のページ単位でのコンテンツリライトなどは基本的におこなわず、ページテンプレートやバックリンクの改善など、内部構造の最適化を重視します。

また、データベースSEOには、HTMLの知識だけでなく開発言語などの専門的な知識も必要であり、コンテンツSEOに比べて専門性や難易度が高くなります。

データベース型サイトのSEOの事例

弊社が担当したデータベース型サイトのSEOに関する3つの事例を紹介します。

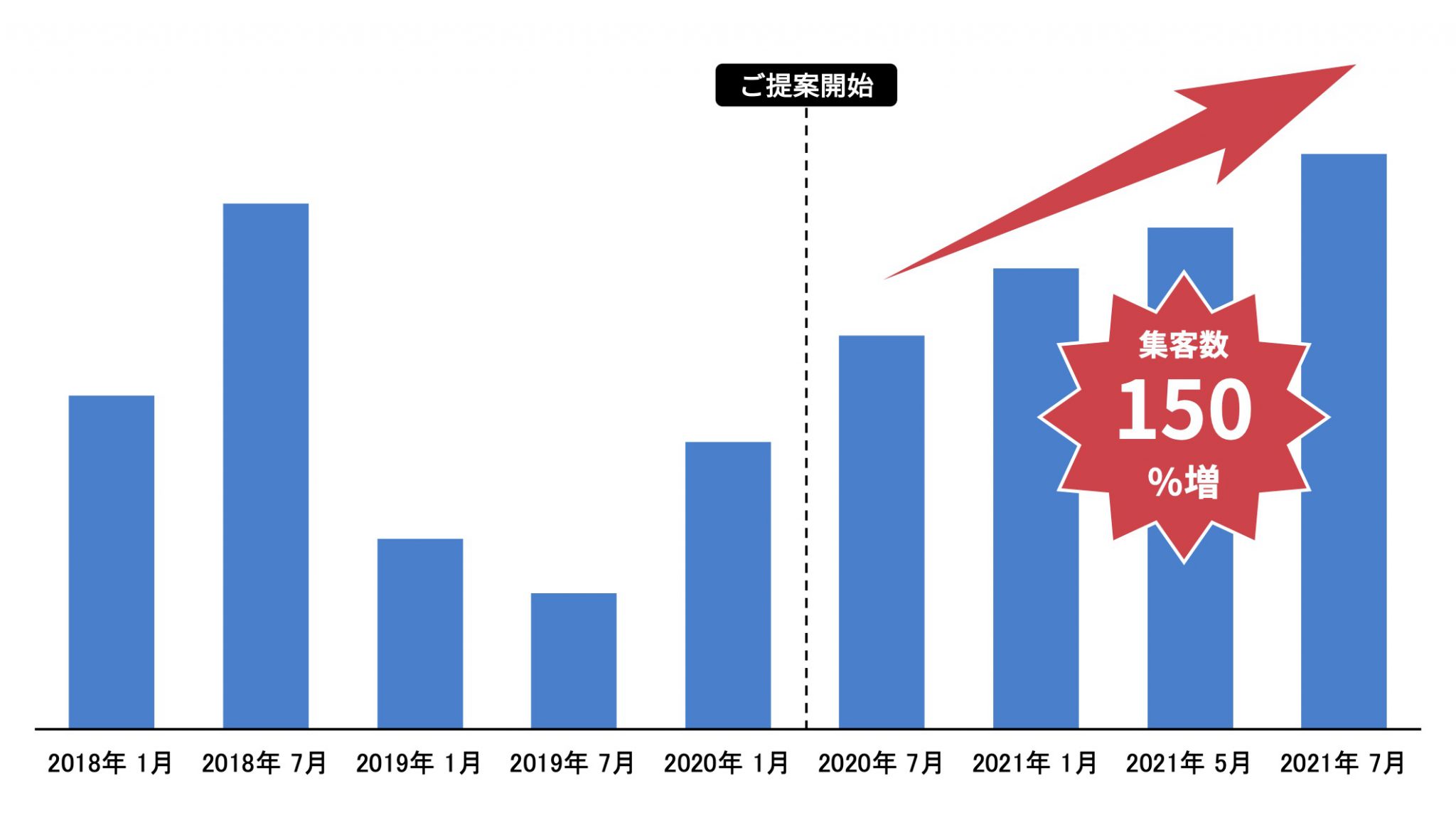

事例1:SEO内部施策によりペナルティを解除、流入数がV字回復

美容業界のお客様の事例です。

依頼のきっかけ:

2018年8月のコアアルゴリズムアップデートにて大幅に流入数が減少した。

課題:

- ペナルティ要素が多数存在する

- 重複コンテンツが発生している

- インデックスの不具合が発生している(不適切なサイトマップXMLの記述、正しくないリダイレクト対応など)

施策:

- 外部リンクの精査

- 正規URLの決定とサイトマップXMLの最適化

- リダイレクト不具合の解消

- キーワード調査

- マークアップ・リンク・カノニカルURLなど、内部構造を最適化

- コンテンツの拡充

成果:

施策開始から1年で流入数を150%増加、KPI達成。

圏外だった多くのビックキーワードが10位圏内にランクイン。

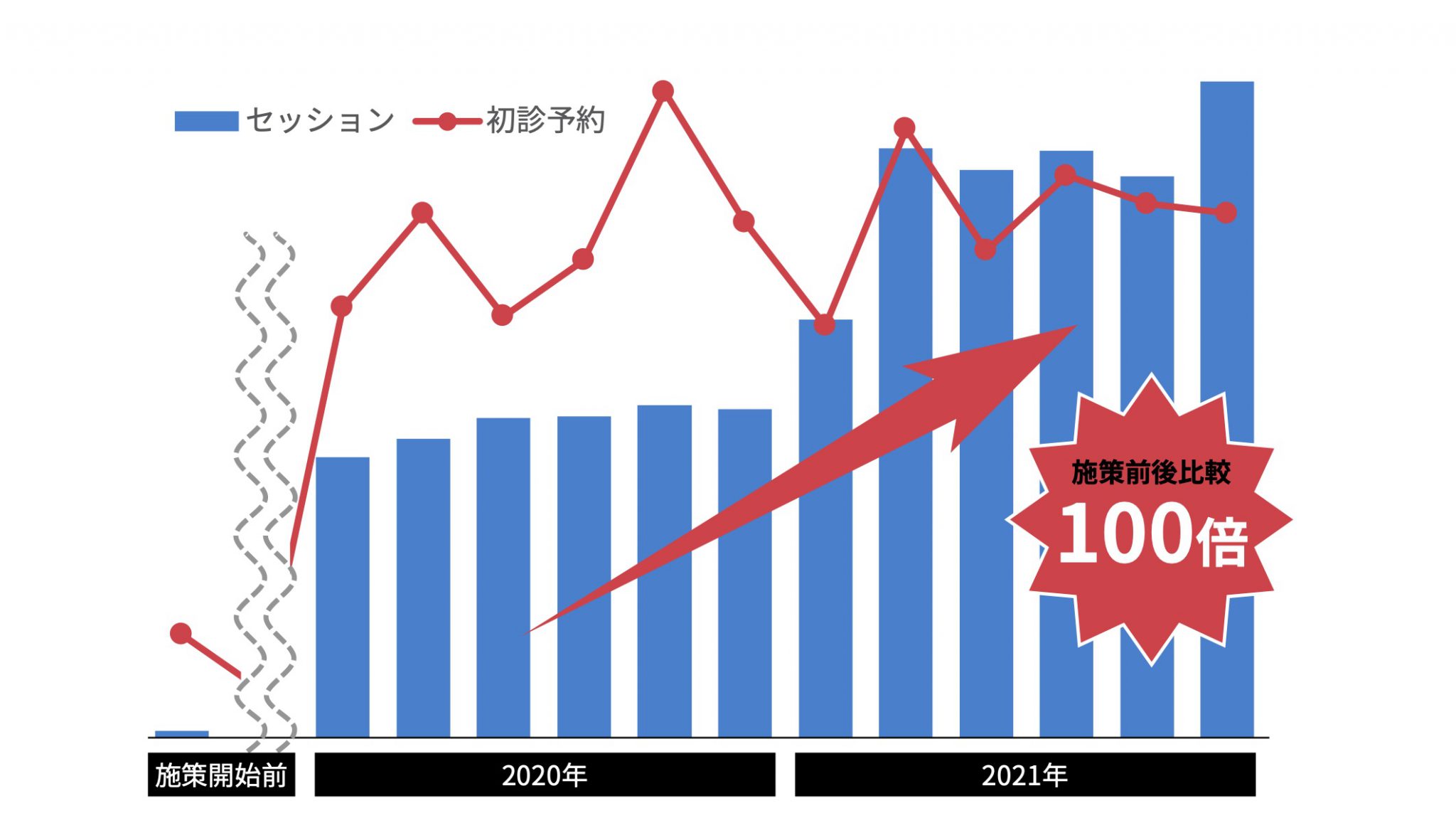

事例2:コンテンツ制作支援とテクニカルSEOの実施でサイト流入100倍!お問合せ数8.5倍!

高度な独自技術と質の高い手術で評判の高いクリニックを経営するお客様の事例です。

依頼のきっかけ:

サイトへの流入はブランドワードがメイン。新規ユーザーのサイト訪問が少なく、サイト経由の初診予約も少ない状況だったため、さらなる事業拡大を図るため、サイトの訪問者を増やすための施策が必要であると考えた。

課題:

- 訪問者増加のために必要なページ数が足りない

- サイト全体の情報量が不足している

- 検索エンジンに適切に認識されていない箇所が多数存在している

施策:

- サイト全体のテクニカルな面での継続的な改修

- 病名や症状に関するコンテンツの継続的な追加

コンテンツのライティングや監修については、医療分野で重要視されている信頼性・専門性に関してその分野の第一人者であるお客さまが一番であると考え、お客さま側で実施していただく体制で進行。

成果:

施策開始から2年で、専門領域の病名において1位獲得、サイトの流入数100倍、お問い合わせ数8.5倍まで伸ばすことに成功。

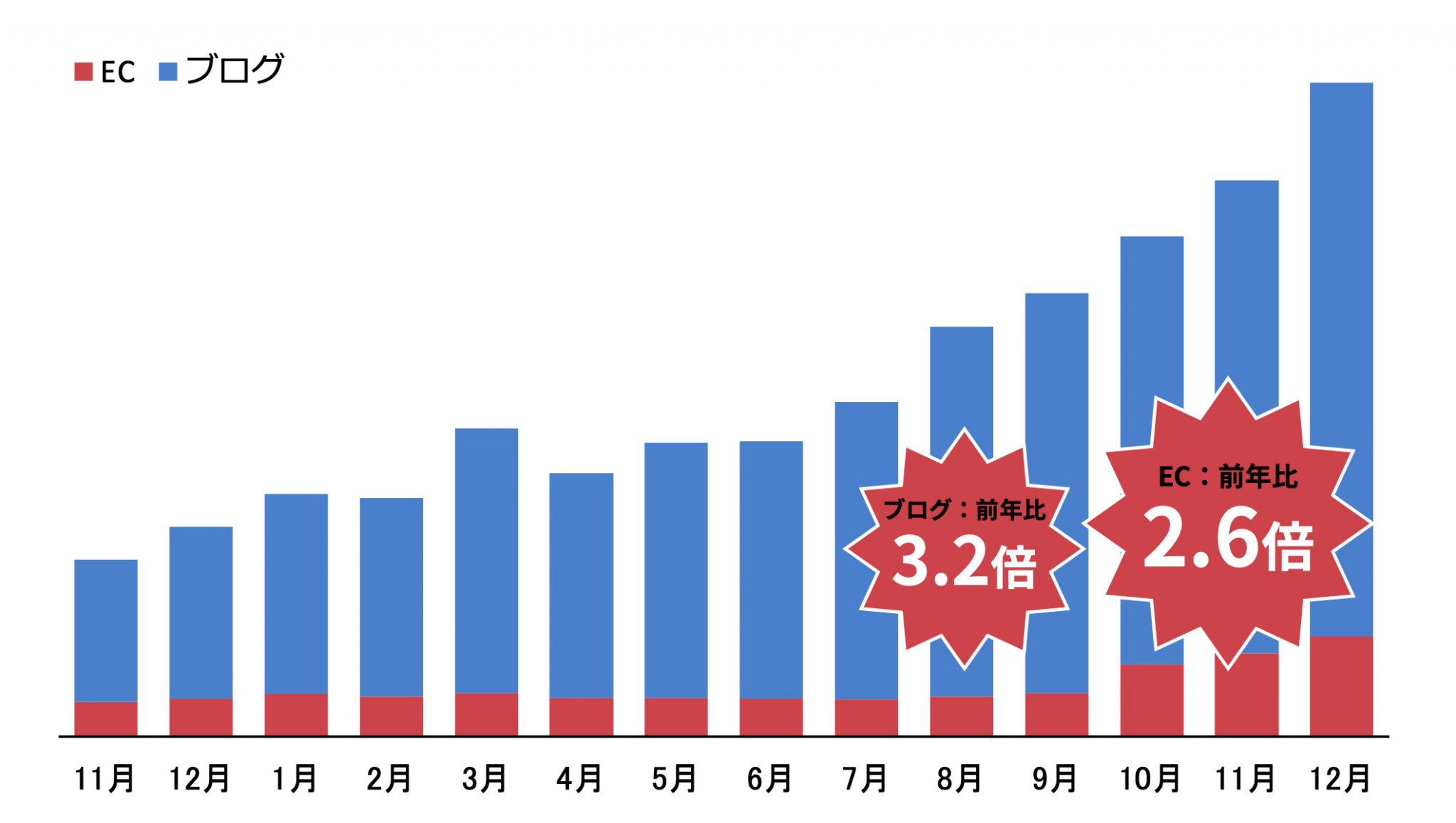

事例3:流入に伸び悩むECサイトで流入350%増

実店舗とECサイトを持つファッション・アパレルブランドを経営するお客様の事例です。

依頼のきっかけ:

BIGキーワードで1位表示できていた記事が3位以下に下落してしまい、それ以降サイトへの流入が減少した。

課題:

- サイトが検索エンジンに最適化されていない

- ユーザーの集客につながるコンテンツが少ない

施策:

商品を販売しているECサイトと、商品にまつわる情報を発信している既存のオウンドメディアで獲得すべきキーワードを切り分け下記施策を実施。

- ECサイトとオウンドメディア両方で内部施策

- ECサイトのユーザビリティ改善施策

- オウンドメディアの既存コンテンツのリライト

- オウンドメディアに新規コンテンツの追加

コンテンツ制作は、こちらで作成した構成案のもとお客様にライティングしていただき、再度弊社でチェック・フィードバックをおこなう体制で進行。

成果:

施策開始から1年で、ECサイトの自然検索経由流入数2.6倍、オウンドメディアは3.2倍と大幅に流入を増やすことに成功。

競合が多く、Amazonや楽天などのモールも上位争いに加わるなか、多くのキーワードで上位表示を達成。

データベース型サイトのSEOのよくある質問

データベース型サイトのSEOに関して、よくある5つの質問をF&Q形式でまとめました。

質問1:データベース型サイトと一般的なWebサイトはなにが違う?

データベース型サイトは、データベースの情報をもとにコンテンツが自動で生成・更新されます。一般的なWebサイトのように手動でページの追加をおこなわないほか、自動的に情報が増えるため保有するデータ量が膨大になりやすいという特徴があります。

質問2:データベース型サイトの具体例は?

代表的なデータベース型サイトの具体例として、主にECサイトや求人サイトが挙げられます。

そのほか不動産情報サイト、グルメサイト、レシピサイト、旅行・ホテルサイト、UGCサイト、美容系や医療系のサイトなども該当します。

質問3:データベースSEOは、コンテンツSEOとどのような違いがある?

データベースSEOは、動的に生成されるページの上位表示を目的として、内部構造の最適化などWebサイト全体を改修します。

一方、コンテンツSEOは、個別ページの上位表示を目的として、各コンテンツのリライトや改善をおこない品質を向上させます。

質問4:データベース型サイトで内容の薄いページが自動生成された場合の対処法は?

データベース型サイトにおいて、内容の薄いまたは空のページが生成されることは珍しくありません。

Google AnalyticsやSearch Console、各種SEOツールを活用して早期発見・対処を行いましょう。これらを利用できない場合、次善策として細かいページのクロールをGoogleに任せ、主要なカテゴリページのみをXMLサイトマップで送信する形での対処を推奨します。

質問5:データベース型サイトのパフォーマンス向上を図るには?

膨大なデータを扱うデータベース型サイトでは、動作・表示速度の低下が起こりやすく、パフォーマンスを向上させるにはデータ容量の管理が重要です。

CPUやメモリ、ディスクなど、サーバーのリソースを適切に割り当て、データベース自体の最適化やキャッシング機能などを活用して処理を最適化します。

まとめ

今回は、データベースSEOについてまとめました。

データベースの情報をもとにコンテンツが自動生成され、膨大な情報量を扱うデータベース型サイトのSEOでは、一般的なSEO施策とは異なり、ページテンプレート単位での改善やサイト全体の改修をメインにおこないます。

内部構造の最適化や良質なバックリンクの獲得など、専門性の高い施策をおこなうため、自社での対応が難しい場合には代行会社への依頼がおすすめです。

データベース型サイトのSEOならお任せください!

デジタルアイデンティティでは、多くのデータベース型サイトのSEOを支援してきました。

データベース型サイトのSEOに関する、こんなお悩みはありませんか?

- 対策の優先順位がわからない…

- 目標やKPIの決め方がわからない…

- SEO会社に依頼しているがなかなか成果が出ない…

- どんなキーワードで対策すれば成果に繋がるかわからない…

- どうすれば競合に勝てるのかがわからない…

弊社では、様々な業界のデータベース型サイトのSEO対策を支援し、改善してきた実績があります。

SEOの専門家として培ってきた技術・ナレッジ、実際の案件をとうして磨いてきた経験・ノウハウを活用し、最短最速で成果に繋がる施策を実行いたします。

データベース型サイトのSEOで一刻も早く成果を出したいとお悩みの方は、ぜひお気軽にご相談ください。

また、過去に開催したデータベース型サイトのSEOに関するセミナー動画も無料公開中です。

求人サイトをメインテーマにしていますが、大規模データベース型サイト全般に通じる内容となっていますので、ぜひご確認ください。

![[無料]成果に繋がる!具体策が分かる!SEOセミナー 「初心者向け」「コンテンツSEO」「サイト内部施策」 詳しくはこちら](https://digitalidentity.co.jp/blog/wp/wp-content/themes/gorgeous_tcd013-child/img/common/bnr/sidebar-seo-seminar.jpg)